AI 시장 규모, 어떻게 읽어야 할까

“AI 시장 $XXX억 달러.” 이 숫자를 매일 접한다. 그런데 이 숫자가 정확히 무엇을 포함하는지는 보고서마다, 기관마다 상당히 다르다.

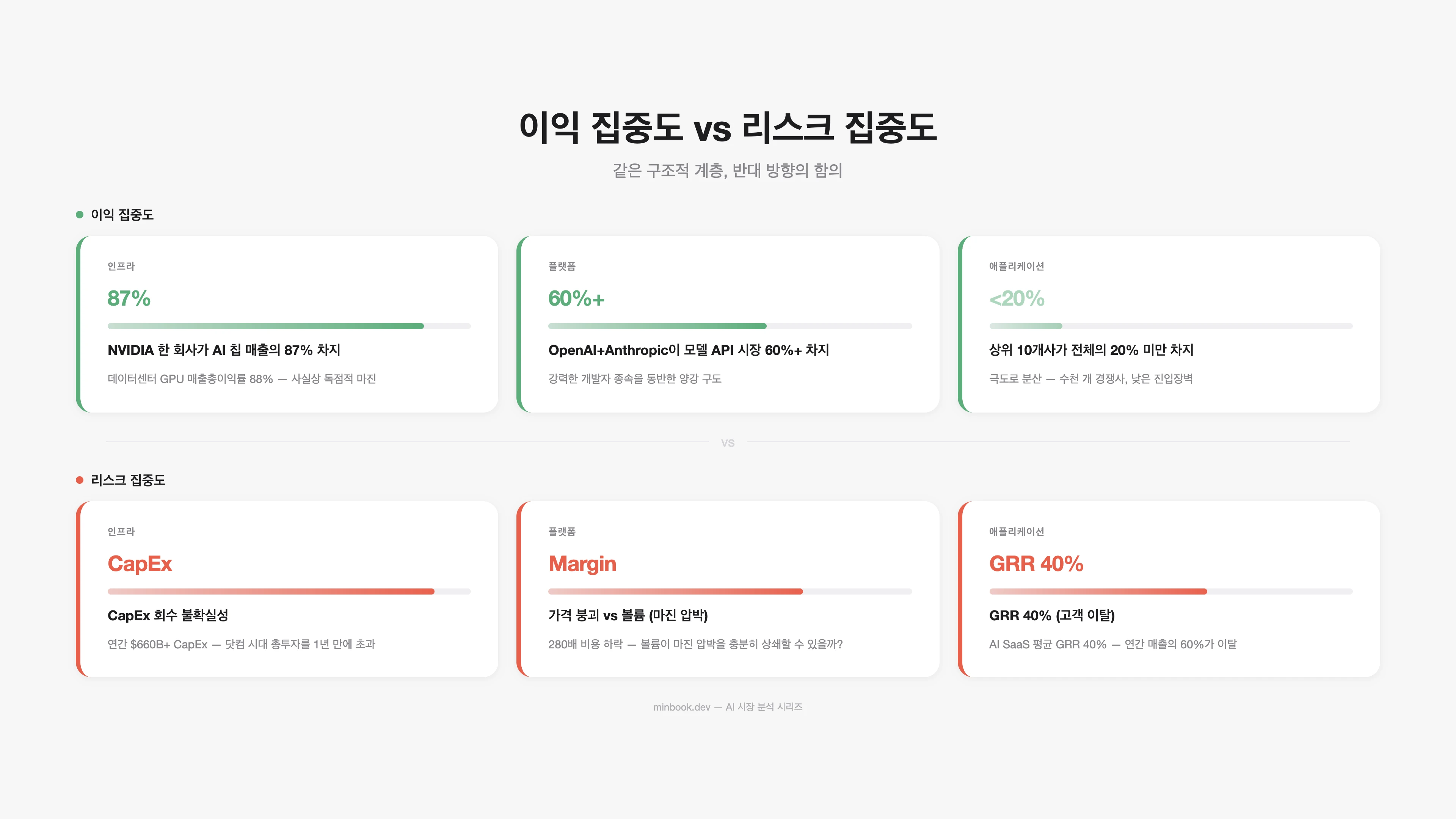

어떤 추정에는 GPU 판매와 클라우드 인프라가 합산되어 있고, 또 다른 추정에는 ChatGPT 구독료와 엔터프라이즈 AI 도구 매출, VC 투자까지 포함되어 있다. 같은 “AI 시장”이라는 이름이지만, GPU를 사는 돈과 AI SaaS 구독료는 성격이 완전히 다르다. NVIDIA가 H100 GPU에서 88% 총이익률을 거두는 시장과, GRR(Gross Revenue Retention)이 40% 수준인 AI SaaS 시장은 같은 잣대로 보기 어렵다.

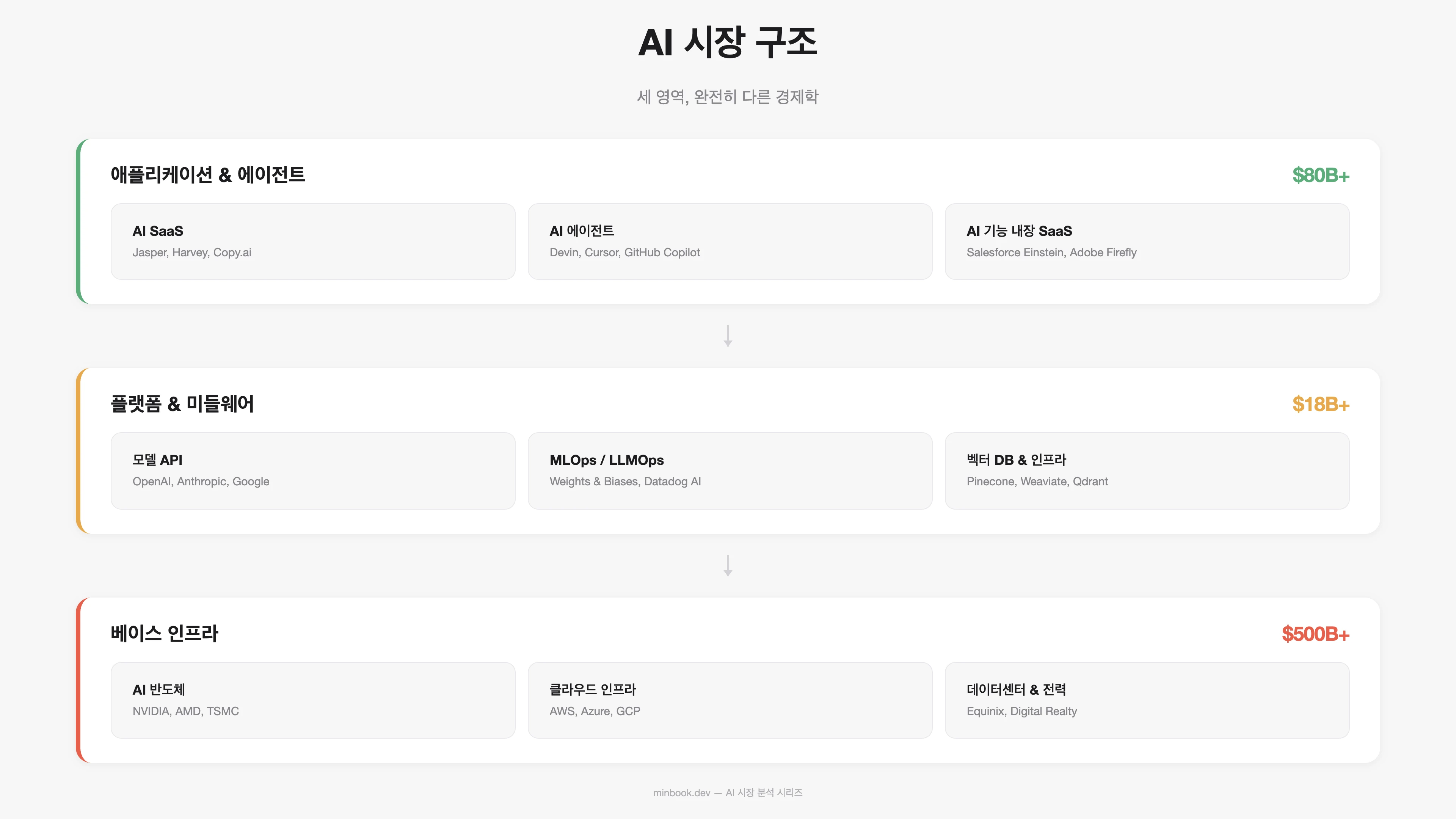

그래서 이 시리즈에서는 AI 시장을 성격이 다른 3개 영역으로 나눠 살펴본다. 각 영역의 추정 규모, 수익 구조, 핵심 플레이어, 그리고 구조적 리스크를 정리해 보았다.

3개 영역으로 나눠 보기

AI 시장을 분석할 때 자주 쓰이는 접근법 중 하나가 밸류 체인 기반 분류다. Gartner, Goldman Sachs, a16z 등 여러 기관이 유사한 분류를 사용하고 있는데, 여기서는 이를 참고하여 인프라 / 플랫폼 / 애플리케이션의 3개 영역으로 구분했다. 각 영역은 비용 구조, 경쟁 역학, 수익 모델이 상당히 다르다.

영역 간 돈의 흐름

이 구조에서 눈여겨볼 부분은 돈의 흐름 방향이다. 원래라면 애플리케이션 영역에서 최종 사용자가 지불한 돈이 플랫폼을 거쳐 인프라로 흘러가며 투자를 회수하는 구조여야 한다. 그런데 현재 AI 시장에서는 인프라에 들어가는 돈이 애플리케이션에서 벌어들이는 돈보다 6배 이상 크다. 이 격차가 단순한 시차인지, 아니면 구조적 불균형인지가 이 시리즈에서 계속 살펴볼 핵심 질문이다.

베이스 인프라 영역 — $500B+ 시장

인프라 영역은 AI를 구동하는 물리적 하부 구조로, 반도체, 클라우드 컴퓨팅, 데이터센터, 전력 인프라를 포함한다. 세 영역 중 금액 기준으로 가장 큰 비중을 차지하고 있다.

규모와 구성

| 세그먼트 | 2025 추정 규모 | 주요 플레이어 | 집중도 |

|---|---|---|---|

| AI 반도체 (GPU/ASIC) | ~$150B+ | NVIDIA (87%), AMD, Intel, Broadcom | 극단적 독점 |

| AI 클라우드 인프라 (IaaS) | ~$200B+ | AWS, Azure, GCP (합산 65%+) | 과점 |

| 데이터센터 & 전력 | ~$150B+ | Equinix, Digital Realty, 각국 유틸리티 | 분산 |

NVIDIA의 데이터센터 매출만 연간 $100B 이상이다(FY2025 기준 $115.2B). AI 클라우드 인프라는 Synergy Research 기준 분기 $100B 이상으로 성장했으며, 연간 $400B+를 향해 가고 있다. 다만 이 중 AI 전용으로 할당된 비율은 추정에 따라 40–60%로 차이가 크다.

Hyperscaler CapEx: 역사적 투자 규모

이 영역의 규모를 결정하는 것은 결국 하이퍼스케일러의 **자본 지출(CapEx)**이다. 2025년 12월 시점 전망에서는 Top 5 하이퍼스케일러(Microsoft, Google, Amazon, Meta, Oracle)의 2026년 CapEx 합산이 $602B으로 추정됐다. 그런데 2026년 2월 실적 발표 이후 이 전망치가 $660B–$690B으로 상향 조정됐다.

| 기업 | 2025 CapEx (실적) | 2026 CapEx (전망) | 주요 용도 |

|---|---|---|---|

| Microsoft | ~$63B | ~$80B | Azure AI, OpenAI 인프라 |

| ~$55B | ~$75B | TPU, Gemini 인프라 | |

| Amazon | ~$75B | ~$100B | AWS Trainium, Bedrock |

| Meta | ~$37B | ~$65B | Llama 학습, AI 추론 |

| Oracle | ~$14B | ~$25B+ | OCI AI 클라우드 |

이 투자 규모를 역사적 맥락에서 비교해 보면 눈에 띈다. 2000년 닷컴 시기 전체 통신 인프라 투자가 인플레이션 조정 기준 약 $500B이었는데, 현재 AI 인프라 투자는 이를 1년 만에 넘어서는 수준이다.

2000년 닷컴 버블 당시 5년간 누적된 통신 인프라 투자와 비슷한 규모가, AI에서는 매년 반복되고 있다. — IEEE Communications Society, 2025.12

인프라 영역의 구조적 특성

높은 집중도. NVIDIA가 AI 가속기 시장 매출의 87%(2024년 기준, Silicon Analysts)를 차지한다. H100 GPU의 제조원가는 약 $3,320, 판매가는 약 $28,000으로 총이익률이 88% 수준이다. 하드웨어 산업에서는 이례적인 소프트웨어급 마진이다.

높은 진입 장벽. 반도체 설계(NVIDIA), 파운드리(TSMC), 클라우드 인프라(AWS/Azure/GCP) 모두 수십 년간의 축적과 대규모 투자가 필요한 영역이라 신규 진입이 쉽지 않다.

수요가 공급을 초과하는 상황. H100/H200/B200 GPU의 대기 시간은 줄었으나, 최신 GPU의 수요-공급 갭은 여전히 존재한다.

플랫폼 & 미들웨어 영역 — $18B+ 시장

플랫폼 영역은 AI 모델을 만들고, 배포하고, 운영하는 도구 생태계다. 모델 API, MLOps/LLMOps, 벡터 DB, 파인튜닝 플랫폼을 포함한다.

규모와 구성

| 세그먼트 | 2025 추정 규모 | 주요 플레이어 | 성장률 |

|---|---|---|---|

| 모델 API (추론) | ~$8B+ | OpenAI, Anthropic, Google | 100%+ YoY |

| MLOps / LLMOps | ~$5B+ | Weights & Biases, Datadog AI, MLflow | 40-60% YoY |

| 벡터 DB & 검색 | ~$2B+ | Pinecone, Weaviate, Qdrant | 80%+ YoY |

| 파인튜닝 / 모델 허브 | ~$3B+ | Hugging Face, Together AI, Replicate | 50%+ YoY |

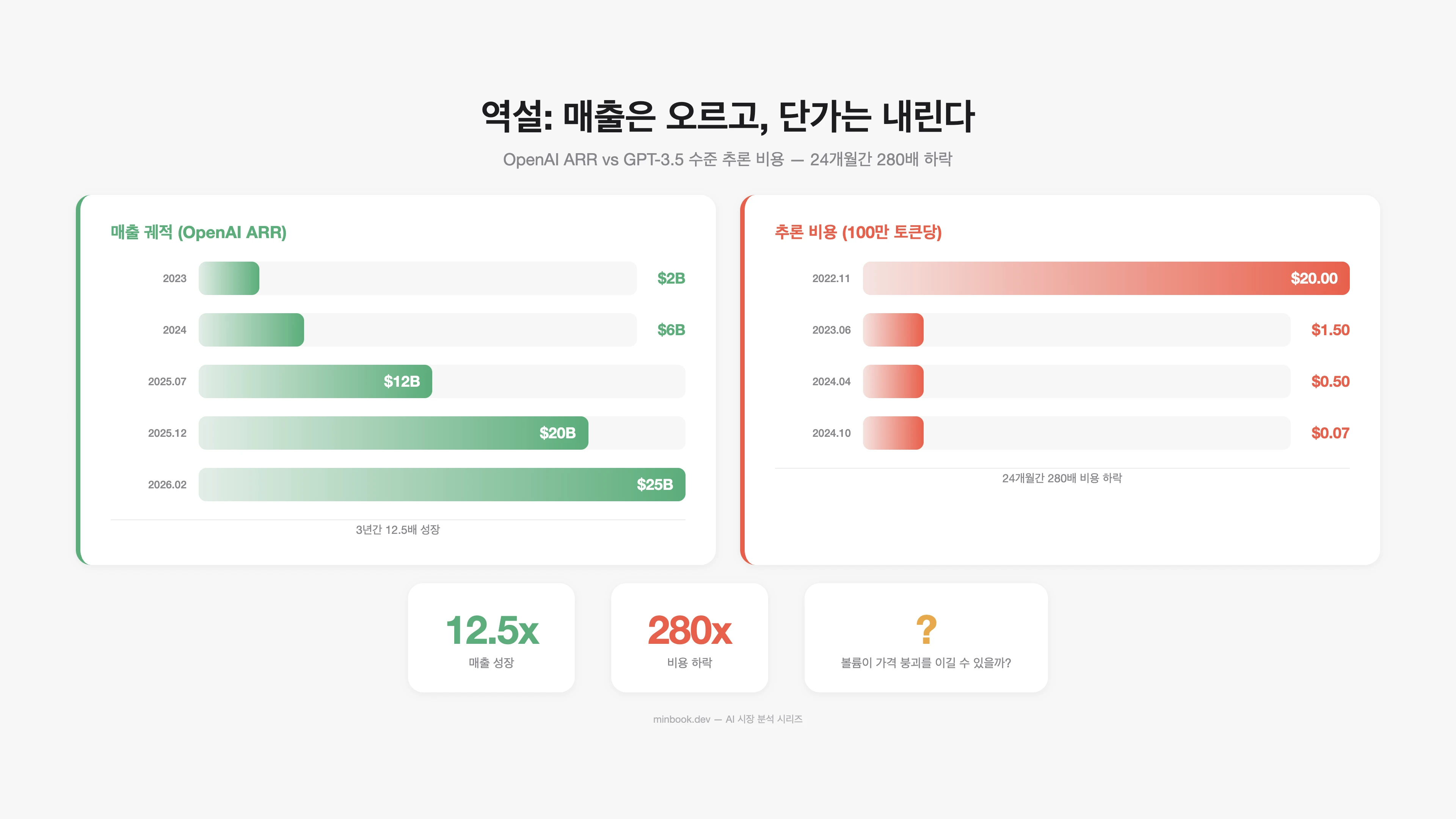

모델 API: 폭발적 성장과 가격 붕괴의 동시 진행

이 영역에서 가장 주목할 현상은 매출은 폭증하는데 단가는 급락하는 구조다.

OpenAI의 ARR은 2023년 $2B에서 2025년 말 $20B으로, 2026년 2월 기준 연환산 $25B을 돌파했다. Anthropic은 2026년 2월 $14B ARR을 기록했고, 3월 현재 Claude Code의 기여로 ~$19B까지 급등했다.

그런데 동시에 LLM 추론 비용은 24개월 만에 280배 하락했다. GPT-3.5 수준 성능 기준, 2022년 11월 백만 토큰당 $20이던 비용이 2024년 10월 $0.07로 떨어졌다(Stanford AI Index 2025).

이 역설의 의미: 볼륨이 가격 하락을 압도하고 있다. 토큰당 가격은 떨어지지만, 사용량이 기하급수적으로 늘어나면서 총매출은 계속 증가. 하지만 이 구조가 영원히 지속될 수 있을까? 가격 하락 속도가 사용량 증가 속도를 추월하는 시점이 온다면? 이것이 플랫폼 영역의 핵심 리스크이며, 5편에서 시나리오별로 분석한다.

플랫폼 영역의 구조적 특성

네트워크 효과가 약하다. 인프라 영역의 클라우드 서비스는 한번 선택하면 전환 비용이 높다. 하지만 플랫폼의 모델 API는 상대적으로 전환이 쉽다. OpenAI API를 쓰다가 Anthropic으로 바꾸는 데 드는 비용은 코드 몇 줄 수정이다. 이는 가격 경쟁을 격화시키고, 마진을 압박한다.

수직 통합 압력. 인프라 영역의 플레이어(Google, Amazon, Microsoft)가 자체 모델(Gemini, Nova, GPT 시리즈)을 통해 플랫폼으로 확장하고 있다. 독립 플랫폼 플레이어(OpenAI, Anthropic)는 이에 대응해 애플리케이션으로 확장 중. 결과적으로 플랫폼 영역은 양방향 압착(Squeeze) 상태.

애플리케이션 & 에이전트 영역 — $80B+ 시장

애플리케이션 영역은 최종 사용자가 실제로 지불하는 AI 제품과 서비스다. AI-native SaaS, AI 에이전트, AI 기능이 통합된 기존 소프트웨어를 포함한다.

규모와 구성

| 세그먼트 | 2025 추정 규모 | 대표 기업 | 특성 |

|---|---|---|---|

| AI-native SaaS | ~$15B+ | Jasper, Copy.ai, Harvey, EvenUp | GRR 40%, 높은 이탈률 |

| AI 에이전트 / Copilot | ~$20B+ | GitHub Copilot, Cursor, Devin | 급성장, 개발자 시장 선도 |

| AI-enhanced 기존 SaaS | ~$45B+ | Salesforce Einstein, Adobe Firefly | 기존 고객 기반 레버리지 |

양면: 큰 기대, 불확실한 수익 지속성

이 영역은 “AI가 모든 소프트웨어를 재편한다”는 내러티브의 실현 무대이기 때문에 투자자들의 관심이 가장 집중되는 영역이다. 2025년 AI VC 투자 $270B 중 상당 부분이 여기를 향했다(전체 VC의 52.7%가 AI 관련, BestBrokers 기준).

다만 수익 지속성에 대해서는 우려가 있다. ChartMogul의 2025년 보고서에 따르면, AI-native SaaS의 중위 GRR은 40% 수준이다. 전통 SaaS의 90%+ GRR과 비교하면 상당한 격차다. 월 구독료 $50 미만 AI 제품은 GRR이 23%까지 떨어지는 것으로 나타났다.

왜 애플리케이션 GRR이 낮은가?

- 전환 비용이 낮다. AI wrapper 제품은 기저 모델이 업데이트되면 차별화가 사라진다. ChatGPT가 새 기능을 추가하면, 그 위에 만든 수십 개의 스타트업 제품이 한 번에 무력화된다.

- 무료 대안이 계속 등장한다. 오픈소스 모델(Llama, Mistral, Qwen)의 성능이 빠르게 개선되면서, 유료 AI SaaS의 가치 제안이 약해진다.

- “Wow → Meh” 패턴. 처음 써볼 때는 놀랍지만, 한계를 발견하면 빠르게 이탈한다. AI 제품 특유의 기대-현실 괴리.

CIO의 현실: 72%가 손익분기 미달

Gartner의 2025년 5월 조사(CIO 및 기술 리더 506명 대상)에서 72%가 AI 투자에서 손익분기 또는 손실을 보고했다. AI 도구 하나를 구매할 때, 라이선스 비용 외에 10가지 숨겨진 비용(데이터 준비, 통합, 교육, 변경 관리 등)이 발생한다는 것이 주된 원인이다.

3개 영역의 수익 구조 비교

세 영역의 핵심 재무 지표를 나란히 놓으면, 각 영역의 경제적 성격 차이가 드러난다.

| 지표 | 인프라 | 플랫폼 | 애플리케이션 |

|---|---|---|---|

| 시장 규모 | $500B+ | $18B+ | $80B+ |

| 대표 기업 마진 | NVIDIA 88% (GPU) | OpenAI 추정 -20–30% | AI SaaS 평균 60–70% (총이익) |

| 고객 유지 | 전환 비용 매우 높음 | 중간 (API 전환 용이) | 매우 낮음 (GRR 40%) |

| 경쟁 강도 | 독점/과점 | 치열한 가격 경쟁 | 극도로 분산, 진입 장벽 낮음 |

| 수익 예측 가능성 | 높음 (장기 계약) | 중간 (usage-based) | 낮음 (높은 이탈률) |

| 투자 회수 기간 | 3–7년 (인프라 감가) | 1–3년 | 6개월–2년 |

AI 시장의 구조적 불균형

”역삼각형” 문제

전통적인 기술 시장에서는 인프라 투자가 먼저 이루어지고, 그 위에 플랫폼이 형성되고, 최종적으로 애플리케이션이 수익을 창출하며 인프라 투자를 회수한다. 인터넷이 그랬고, 모바일이 그랬고, 클라우드가 그랬다.

AI 시장은 이 구조가 뒤집혀 있다.

| 인프라 투자 (연간) | 애플리케이션 매출 (연간) | 비율 | |

|---|---|---|---|

| 인터넷 (2000년) | ~$100B | ~$30B | 3.3:1 |

| 클라우드 (2015년) | ~$50B | ~$40B | 1.25:1 |

| AI (2026년) | ~$660B+ | ~$80B | 8:1 이상 |

AI의 인프라 대비 애플리케이션 매출 비율은 8:1 이상으로, 닷컴 시기의 3.3:1보다 격차가 크다. 물론 단순 비교에는 한계가 있지만, 이 비율이 시사하는 바는 분명하다 — 애플리케이션 영역의 매출이 인프라 투자를 정당화하는 수준으로 성장할 수 있을지가 핵심 질문이다.

하지만, 이전과 다를 수도 있다

비관론만 있는 것은 아니다. AI 시장이 이전 기술 사이클과 다를 수 있는 이유가 세 가지 있다.

-

엔터프라이즈 수요가 이미 실재한다. 닷컴 시대의 인프라 투자는 “미래에 올 수요”를 위한 것이었다. AI 인프라 투자는 현재 GPU가 부족해서 이루어지고 있다. 수요가 투자를 선행하고 있다.

-

하이퍼스케일러의 재무 체력이 다르다. 2000년 당시 통신사들은 부채로 인프라를 깔았다. 현재 하이퍼스케일러 5사의 현금 보유량은 합산 $500B 이상이다. CapEx의 상당 부분을 자기 자본으로 집행할 수 있다.

-

AI 추론 비용이 빠르게 하락하고 있다. 24개월간 280배 하락은 무어의 법칙보다 빠르다. 비용 하락이 계속되면, 현재 비용 문제로 도입하지 못하는 기업 수요가 폭발적으로 해금될 수 있다.

Sources

- NVIDIA FY2025 실적 — NVIDIA 10-K Filing (SEC), Data Center Revenue $115.2B

- Hyperscaler CapEx 전망 — IEEE Communications Society (2025.12), CNBC (2026.02), Futurum Group (2026.02)

- LLM 추론 비용 하락 — Stanford AI Index Report 2025, a16z “LLMflation”

- OpenAI ARR — PYMNTS (2026.01), OpenAI CFO Sarah Friar

- Anthropic ARR — SaaStr (2026.02, $14B), Yahoo Finance (2026.03, ~$19B)

- AI SaaS GRR 40% — ChartMogul “SaaS Retention: The AI Churn Wave” (2025.09)

- AI VC 투자 — OECD (2026.02, $258.7B/61%), BestBrokers ($270.2B/52.7%)

- CIO AI 투자 ROI — Gartner Newsroom (2025.05 조사, n=506)

- NVIDIA AI 가속기 점유율 — Silicon Analysts

- H100 원가/마진 분석 — Jarvislabs, Cyfuture Cloud

관련 글

NVIDIA Tax — GPU가 AI 이익의 대부분을 가져가는 구조

NVIDIA H100의 88% 마진 구조를 해부하고, AI 칩 독점이 생태계에 미치는 영향과 3가지 독점 해체 시나리오를 분석

AI eats the world 2026 — Benedict Evans 79장 deck 정리

Evans 2026 deck 79장 정리. 자본·도입·변화 3챕터 + 인프라 폭발이 가치 포착으로 안 이어진다는 한 가지 질문

2027 AI 시장 시나리오 — $660B 투자의 결말

AI 시장 $660B CapEx의 3가지 시나리오(Bull/Base/Bear) 분석과 영역별 생존 전략