들어가며

올해 1분기에 AI 에이전트 관련 영상을 두 편 봤는데, 시기도 비슷하고 주제도 겹치는데 시각 차이가 꽤 흥미로웠다. 하나는 2월 초, 다른 하나는 3월 말. 불과 8주 차이인데 온도차가 상당해서 교차 분석을 해봤다.

2월 1일에 올라온 Lex Fridman Podcast #490에서 AI2의 Nathan Lambert는 computer use에 대해 이렇게 평가했다.

"Computer use — Claude can use your computer, OpenAI had Operator,

and they all suck."

— Nathan Lambert, Lex Fridman Podcast #4907주 뒤인 3월 21일, 한국의 AI 사업가 노정석은 OpenClaw Seoul 밋업에서 돌아온 직후 이런 반응을 보였다 — “야, 저게 일의 미래구나.” 에이전트가 배민에서 치킨을 주문하고, 카카오택시를 부르는 데모를 직접 본 뒤였다.

같은 분기, 같은 주제인데 이 온도차는 어디서 올까? 두 영상 사이에 OpenClaw라는 사건이 있었다.

Before: “They All Suck” (2026년 2월 1일)

Lex Fridman Podcast #490은 4시간 25분짜리 AI 현황 총정리다. Sebastian Raschka(ML 연구자, Build a LLM from Scratch 저자)와 Nathan Lambert(AI2 post-training lead, RLHF 전문가)가 게스트로 출연했다.

Computer Use에 대한 평가

에이전트와 컴퓨터 유즈가 화제로 떠오르자, Nathan은 꽤 직접적으로 평가한다.

"Computer use is a good example of what labs care about and

we haven't seen a lot of progress on. We saw multiple demos

in 2025 — Claude can use your computer, OpenAI had Operator

— and they all suck."

— Nathan Lambert (03:17:37)Sebastian도 같은 맥락이다. 문제는 모델의 능력 부족만이 아니라, 사용자가 에이전트에게 태스크를 어떻게 전달하느냐라는 인터페이스 자체에 있다는 것이다.

"For arbitrary tasks, you still have to specify what you want

your LLM to do. You can say what the end goal is, but if it

can't solve the end goal... how do you, as a user, guide the

model before it can even attempt that?"

— Sebastian Raschka (03:18:10)여행을 예약해 달라고 했는데 신용카드 정보를 잘못 입력했다. 그걸 고치려면 사용자가 다시 개입해야 한다. 그 개입을 위한 인터페이스가 아직 설계조차 안 됐다는 지적이다.

”Jagged AI” — 들쭉날쭉한 능력치

Nathan은 이 에피소드에서 Jagged AI라는 프레임워크를 제시한다.

AI는 특정 영역에서 이미 초인적이다. 프론트엔드 코딩, 전통 ML 파이프라인 구축, 텍스트 요약 등. 하지만 분산 ML 학습 시스템 설계처럼 훈련 데이터가 희소한 영역에서는 여전히 부족하다. 흥미로운 건 모델이 강해질수록 이 격차가 줄어들기보다는 오히려 벌어진다는 것이다. 잘하는 건 더 잘하게 되고, 못하는 건 훈련 데이터가 없으니 여전히 못한다.

"I think the camp that I fall into is that AI is so-called

'jagged,' which will be excellent at some things and really

bad at some things."

— Nathan Lambert (03:25:00)AI27 리포트가 제시한 마일스톤 — superhuman coder → AI researcher → ASI — 에 대해서도 Nathan은 회의적이다. “Superhuman coder”는 completeness를 전제하는 개념인데, jagged한 AI에게 완전성은 달성하기 어렵다. 인간이 그 구멍을 메우며 함께 빠르게 움직이는 역할로 상당 기간 남을 것이라는 게 그의 관점이다.

”그 꿈은 죽어가고 있다”

Nathan이 한 발언 중 인상적이었던 것:

"That dream is actually kind of dying...

the 'one model to rule everything' ethos."

— Nathan Lambert (03:25:56)하나의 범용 모델이 코딩도 하고, 이메일도 쓰고, 여행도 예약하고, 과학 연구도 하는 세상. 그건 실현되기 어렵다는 것이다. Sebastian은 “Amplification, not paradigm shift”라고 정리했다. 모든 게 증폭되지만, 패러다임 전환은 아니라는 입장.

2월 1일 시점에서 이 두 연구자의 공통 시각은 이랬다 — 에이전트는 아직 이르다, computer use는 데모 수준이다, 범용 에이전트의 시대는 생각보다 멀 수 있다.

그 사이에 일어난 일: OpenClaw

Lex 에피소드가 올라오기 직전, OpenClaw가 세상에 나왔다.

시작은 2025년 11월, 오스트리아 개발자 Peter Steinberger가 금요일 밤에 “대략 한 시간 만에” LLM을 Telegram에 연결한 Clawdbot이었다. 1월 말 Anthropic의 상표권 이의 제기를 거쳐 OpenClaw로 이름을 바꾼 게 1월 30일. Lex 에피소드가 올라온 건 그 이틀 뒤인 2월 1일이다. 즉, Nathan과 Sebastian이 녹화할 시점에 OpenClaw는 이제 막 현재의 이름을 얻은 상태로, 아직 본격적으로 알려지기 전이었다.

그 이후에 폭발했다. 수 주 만에 GitHub 역사상 가장 빠르게 성장하는 오픈소스 프로젝트가 됐고, 3월 22일에는 45개 신기능, 82개 버그 수정을 포함한 대규모 업데이트(v2026.3.22)가 나왔다.

그런데 OpenClaw에서 눈여겨볼 부분은 코드 자체보다 문제를 바라보는 방식의 변화라고 생각한다.

Nathan과 Sebastian이 고민한 문제는 이것이었다:

- AI가 처음부터 컴퓨터를 인간처럼 쓸 수 있는가?

- 로그인을 처리하고, 화면을 인식하고, 네비게이션하고, 에러를 복구할 수 있는가?

- 임의의 태스크를 자연어로 전달받아 end-to-end로 수행할 수 있는가?

이 질문들에 대한 답은 2월 시점에서 “아직 아니다”였고, 그 평가는 맞았다.

OpenClaw는 이 질문을 다르게 던졌다. “인간이 이미 로그인해둔 환경에서, 에이전트가 반복 작업을 대행하면 되지 않나?”

에뮬레이터에 이미 로그인된 앱들, 인간의 기존 credential과 세션. API가 있으면 API를 쓰고, 없으면 CUA(Computer Use Agent)로 화면을 조작한다. 에이전트가 처음부터 모든 것을 해결할 필요 없이, 인간이 세팅한 환경 위에서 정해진 플로우를 반복하는 것이다.

기술적 돌파라기보다는 프레이밍의 전환에 가깝다.

After: “저게 일의 미래구나” (2026년 3월 21일)

노정석은 Scionic/KYYB 대표이자, 한국 AI 커뮤니티에서 활발하게 실험하는 사업가 중 한 명이다. 그의 유튜브 EP91은 3월 21일 토요일 아침에 녹화됐다. OpenClaw Seoul 밋업에 다녀온 바로 다음 날이었다.

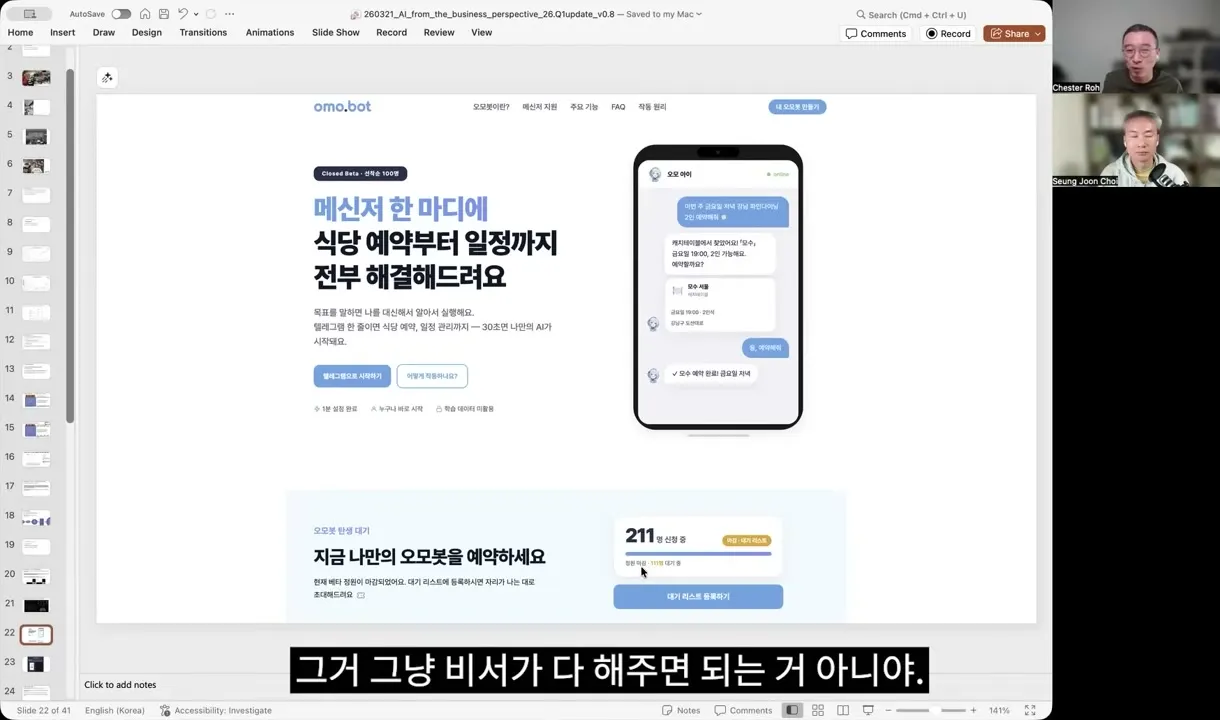

OMO.BOT — 에이전트 앱의 프로토타입

밋업에서 Simon이라는 개발자가 보여준 OMO.BOT이라는 에이전트 앱 데모가 인상적이었다고 한다.

짜장면을 시키려면 배민, 생수를 주문하려면 쿠팡, 택시를 부르려면 카카오택시. 각각 다른 앱을 열어야 한다. 그냥 비서한테 시키면 안 되나? OMO.BOT이 그걸 구현했다. API가 있는 서비스는 API로, 없는 서비스는 CUA로 연결해서 하나의 인터페이스로 처리한다.

”에이전트의 function call이 된다”

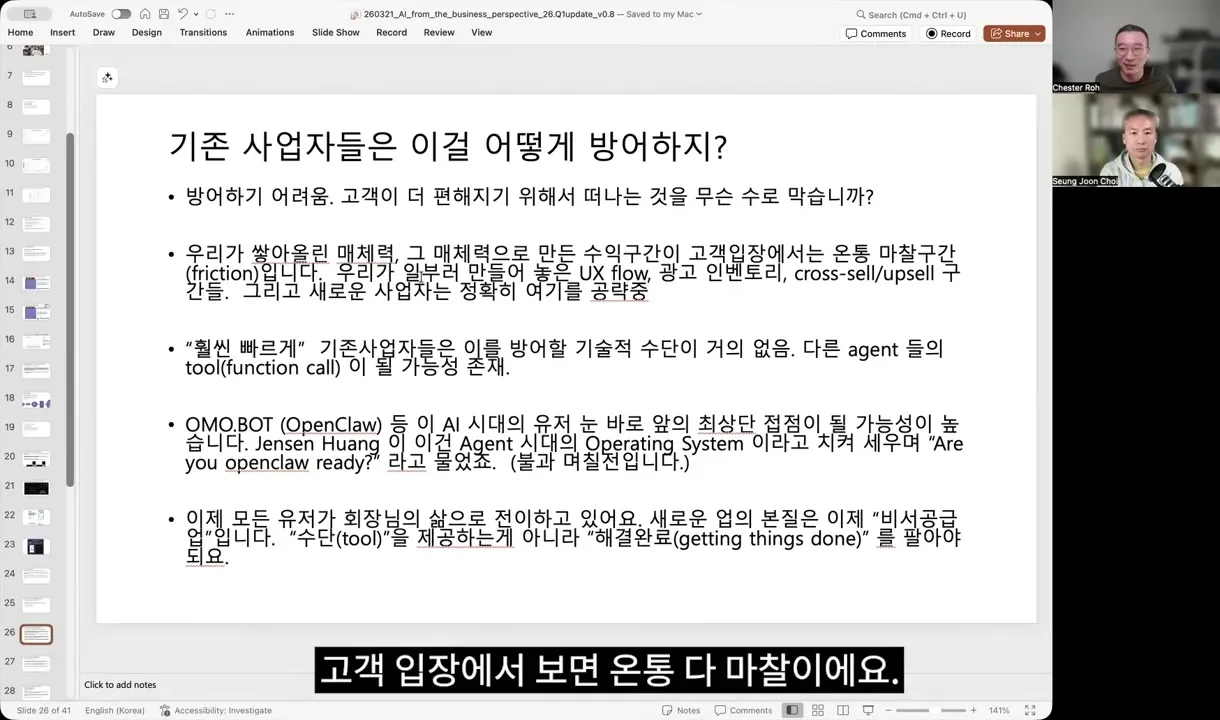

노정석은 이 데모에서 비즈니스 구조의 변화 가능성을 읽어낸다.

"기존 사업자들은 다른 에이전트들의 function call이 될

가능성이 매우 농후한 거죠. 못 막아요."

— 노정석 (47:10)배민, 쿠팡, 카카오택시 — 이들이 쌓아온 것은 사용자와 공급자 사이의 매체력이다. UX 안의 광고, 크로스셀, 강제적인 동선. 그것이 곧 마진이었다. 에이전트가 이 friction을 건너뛰면, 사용자 입장에서는 더 편하니 돌아갈 이유가 줄어든다.

노정석의 논거는 단순하다:

"내 에뮬레이터에 내가 로그인해 놓고 그 에뮬레이터를

내 에이전트가 조작하면 어떻게 막죠?"

— 노정석 (48:22)Nathan이 “they all suck”이라고 평가한 Computer Use의 한계 — 로그인 실패, 화면 인식 오류 등 — 가 OpenClaw 패러다임에서는 상당 부분 줄어든다. 인증은 인간이 이미 해결했고, 에이전트는 그 위에서 특정 플로우만 반복하면 되기 때문이다.

GTC에서의 반응

같은 시기 열린 NVIDIA GTC 2026(3월 16일)에서 Jensen Huang은 OpenClaw를 “the next ChatGPT”이자 “operating system for personal AI”라고 불렀다. 런칭 2개월 만에 NVIDIA CEO가 키노트에서 언급하는 수준이 된 것이다. NVIDIA 자체도 NemoClaw라는 엔터프라이즈 버전을 발표했다.

노정석은 이 흐름을 요약하며 물었다 — “Are you OpenClaw ready?” 모든 비즈니스가 이 질문에 답해야 하는 시점이 왔다고.

무엇이 달라졌는가

두 영상의 온도차를 살펴보면, 기술 역량의 차이보다는 문제의 프레이밍 차이가 크다고 느꼈다.

Lab-driven vs Community-driven

Lex 게스트들이 평가한 것은 랩이 만든 top-down 솔루션이었다. Anthropic의 Claude Computer Use, OpenAI의 Operator. 모델 하나가 화면 인식부터 로그인, 네비게이션, 에러 복구까지 end-to-end로 처리하려는 접근이다. 실제로 잘 안 됐다.

OpenClaw는 커뮤니티가 만든 bottom-up 조합이었다. 모델이 모든 걸 혼자 할 필요 없이, 인간이 환경을 세팅하고 에이전트는 그 안에서 작동한다. API 플러그인, CUA 모듈, 하네스가 커뮤니티에 의해 빠르게 조합된다.

이 패턴은 기술 역사에서 반복되어 온 것이기도 하다. IBM 메인프레임(top-down) vs PC 조립 생태계(bottom-up), Apple 폐쇄 생태계 vs Android 오픈 생태계. 기술이 충분히 성숙하면 community-driven 조합이 lab-driven 솔루션을 추월하는 시점이 온다.

Specification 문제의 우회

Sebastian이 제기한 핵심 문제가 있었다. “임의의 태스크를 에이전트에게 어떻게 전달하느냐?” 여행 예약 같은 복잡한 태스크에서, 모델이 시도하기도 전에 사용자가 모든 조건을 명시해야 한다.

OpenClaw 생태계에서는 이 문제가 다르게 풀린다. 범용적인 “아무거나 해줘”가 아니라, 특정 서비스의 특정 플로우를 하네스로 만들어둔다. “배민에서 치킨 주문”은 정해진 단계가 있고, 에이전트는 그 단계를 따르면 된다. specification이 하네스 안에 이미 내장되어 있는 셈이다.

노정석이 별도로 도달한 결론과도 겹친다.

"데이터 커넥터 깔끔하게 만들고, 프롬프트 잘 쓰고,

프론티어 모델을 붙이는 게 성능은 제일 좋아요."

— 노정석 (58:24)그의 회사에서 4년간 온갖 AI 프레임워크(Pydantic, LangChain, agent SDK, LoRA, 자체 모델 등)를 시도한 끝에 도달한 결론이라고 한다. Lex 에피소드에서 Sebastian이 강조한 spec-driven design도 본질적으로 같은 이야기다. AI 코딩이 실패하는 대부분의 경우, 모델의 한계가 아니라 인간의 명세 부족이 원인이라는 것.

양쪽 다 결국 같은 지점을 가리키고 있었다. 모델은 이미 충분히 강하고, 병목은 모델과 현실 세계를 연결하는 방식에 있다. 다만, 2월에는 그 연결 방식이 안 보였고, 3월에는 OpenClaw가 하나의 답을 보여준 것이다.

그래도 남는 질문들

OpenClaw가 모든 것을 해결한 건 아니다. Lex 에피소드에서 제기된 문제들 중 여전히 유효한 것들이 있다.

보안과 Prompt Injection

노정석이 솔직하게 인정한 부분이다.

"OpenClaw는 감히 제 랩탑에 못 깔았어요. VM을 깔아서

리눅스를 새로 올리고 그 위에서 테스트했고, 외부 DGX

박스에 세팅해 놓고 있습니다."

— 노정석 (01:11:16)소셜, 금융 관련 credential은 아직 위임하기 어렵다. 에이전트의 자율성이 높아질수록 prompt injection 리스크도 커진다. 공동 진행자 최승준도 이 점을 짚었다 — 에이전트들이 injection에 취약하고, 2FA 같은 보안 체계도 완벽하지 않다는 것.

Jagged AI는 여전하다

Nathan의 “jagged AI” 프레임은 OpenClaw 이후에도 유효하다. OpenClaw가 우회한 것은 접근과 인증의 문제지, 모델 자체의 들쭉날쭉함이 아니다. 정해진 플로우를 따르는 것은 잘 하지만, 예외 상황에서의 판단은 여전히 불안정할 수 있다.

다만 노정석은 이에 대해 다른 시간 감각을 갖고 있다. 그가 인용한 Claude Code 제작자 Boris Cherny의 말:

"The most general one is the most specific one.

지금 풀리지 않는다면 덮어둬, 6개월 있다 그때 모델이 풀 테니까."

— Boris Cherny (via 노정석)경제적 임팩트는 아직

Lex 에피소드에서 세 사람이 공유한 의문도 남아 있다. AI의 경제적 임팩트가 실제로 GDP에 반영된 적이 아직 없다는 것. 에이전트가 치킨을 대신 주문하는 건 편리하지만, 산업 구조를 바꾸는 수준의 변화로 이어지려면 시간이 더 필요할 것 같다.

두 영상을 교차해서 보면

이 두 영상을 나란히 놓고 보면서 느낀 점을 세 가지로 정리해봤다.

첫째, AI 전망의 유통기한이 짧아졌다. Nathan의 “they all suck”은 2월 시점에서 정확한 평가였다. 그런데 7주 후에는 이미 불완전한 평가가 됐다. 전문가의 판단도 8주면 업데이트가 필요한 시대다.

둘째, 기술적 돌파보다 프레이밍의 전환이 빠를 수 있다. OpenClaw는 Computer Use를 “풀지” 않았다. 모델의 화면 인식 능력이 갑자기 좋아진 게 아니다. 대신, “AI가 컴퓨터를 처음부터 쓸 줄 알아야 한다”를 “인간이 세팅한 환경에서 에이전트가 반복 실행한다”로 바꿔서 기존 한계를 우회했다.

셋째, 연구자와 실무자가 결국 같은 곳을 가리킨다. Nathan의 “spec-driven design”과 노정석의 “데이터 커넥터 + 프롬프트 + 프론티어 모델”. Sebastian의 “도메인 이해가 핵심”과 노정석의 “프롬프트를 잘 쓰려면 엔지니어링이 아니라 도메인 이해가 중요하다”. 언어는 다르지만 수렴점은 같다. 모델은 이미 충분히 강하고, 병목은 모델과 현실을 연결하는 명세의 품질에 있다.

노정석은 이걸 이렇게 표현했다.

"모든 문제를 compute를 이용한 search problem으로 전환하고,

그 compute이 그 문제를 순식간에 풀어버리는 새로운 시대로

우리가 진입하고 있다."

— 노정석 (10:17)Nathan은 다른 각도에서 비슷한 이야기를 했다.

"RLVR in real scientific domains — startups with wet labs

where they're having language models propose hypotheses

that are tested in the real world."

— Nathan Lambert (02:15:30)보상 신호를 만들 수 있는 환경을 확보한 쪽이 유리하다. 노정석의 언어로는 “non-verifiable을 verifiable로 전환할 수 있는 환경”, Nathan의 언어로는 “RLVR 환경을 구축한 스타트업”. 결국 같은 구조다.

OpenClaw는 그 “환경”의 한 사례가 됐다. 커뮤니티가 만든 하네스와 플러그인이 보상 환경 역할을 하고, 에이전트가 태스크를 수행하면 성공/실패가 즉시 피드백된다. 그 피드백으로 더 나은 하네스가 만들어진다. 노정석이 표현한 “우로보로스의 뱀” — 모델이 좋아지면 하네스가 좋아지고, 하네스가 좋아지면 데이터가 좋아지고, 데이터가 좋아지면 모델이 좋아지는 순환이다.

8주 전에는 이 순환이 보이지 않았는데, 지금은 돌아가고 있다.

이 글에서 분석한 영상:

- Lex Fridman Podcast #490 “State of AI in 2026” (2026.02.01) — Sebastian Raschka, Nathan Lambert

- 노정석 EP91 “26.1Q 비즈니스 관점에서의 AI” (2026.03.21) — 노정석, 최승준

관련 글

신원 트랙 — Proof of Personhood부터 AI 에이전트 위임까지

사람 증명과 AI 에이전트 신원은 같은 트랙의 두 layer다. World ID·Passkey·DID의 채택 곡선 + Defakto·t54·Indicio·결제 네트워크 진입까지 신원 트랙 전체를 한 글에

Headless 시대, 가치는 어디로 협공당해 모이는가 — 빌더 레이어의 수직 압축

빌더 레이어는 위(하이퍼스케일러)와 아래(모델랩)에서 동시에 압축되고, 가치는 맞춤 ops 조립과 그 위 방어가능성 조건으로 이동한다.

노코드는 잡아먹힐까, 더 귀해질까 — 코드 에이전트 시대의 양면

코드 비용이 0에 수렴해도 노코드는 죽지 않는다. 같은 시점에 검증·재현·감사 비용이 같이 오르기 때문이다. 둘은 양자택일이 아니라 레이어로 쌓인다.