LangChain, LlamaIndex, CrewAI 3사의 오픈소스 수익화 전략 비교. 프레임워크 무료 배포 후 운영 계층(LangSmith 등)에서 과금하는 패턴과 1인 빌더가 참고할 포인트 정리.

오픈소스 프레임워크는 무료입니다

LangChain, LlamaIndex, CrewAI. AI 애플리케이션을 만들 때 가장 많이 쓰이는 프레임워크 3개는 모두 오픈소스입니다. MIT 라이선스이고, 누구나 무료로 쓸 수 있고, 상업적 사용도 제한이 없습니다.

그런데 이 회사들은 수천만 달러에서 수억 달러의 투자를 받았습니다.

| 회사 | 프레임워크 라이선스 | 누적 투자 | 최근 밸류에이션 | GitHub Stars |

|---|---|---|---|---|

| LangChain | MIT | ~$45M (Series A, 2024) | ~$300M | 100K+ |

| LlamaIndex | MIT | ~$34M (Series A, 2024) | ~$220M | 38K+ |

| CrewAI | MIT | ~$18M (Series A, 2024) | 비공개 | 25K+ |

무료 프레임워크를 만드는 회사에 왜 이 돈이 들어갔을까요? 답은 프레임워크 자체가 아니라, 프레임워크 위에 올리는 유료 레이어에 있습니다.

공통 패턴: 프레임워크 무료 → 운영 계층 유료

세 회사 모두 동일한 구조를 따릅니다.

graph TB

subgraph FREE["오픈소스 (무료)"]

A["프레임워크"]

B["SDK / 라이브러리"]

C["커뮤니티 / 튜토리얼"]

end

subgraph PAID["상용 플랫폼 (유료)"]

D["관측 / 모니터링"]

E["배포 / 호스팅"]

F["팀 협업 / 관리"]

end

A -->|"개발자 유입"| D

B -->|"프로덕션 전환"| E

C -->|"팀 확장"| F

style FREE fill:#e8f5e9,stroke:#4caf50

style PAID fill:#fff3e0,stroke:#ff9800이 패턴의 핵심 논리는 간단합니다:

- 프레임워크로 개발자를 모은다 — 무료이므로 진입 장벽이 없음

- 개발자가 프로덕션에 올리면 운영 문제가 생긴다 — 디버깅, 모니터링, 평가

- 운영 문제를 해결하는 유료 도구를 판다 — 여기서 수익 발생

프레임워크는 고객 획득 채널이고, 유료 플랫폼이 실제 제품입니다. 프레임워크만으로는 비즈니스가 성립하지 않습니다.

LangChain → LangSmith: Seat + Usage 하이브리드

프레임워크 포지셔닝

LangChain은 LLM 애플리케이션 개발의 “스위스 군용칼”입니다. 체인, 에이전트, RAG, 메모리 등 거의 모든 LLM 패턴에 대한 추상화를 제공합니다. 2023년 초 출시 이후 가장 빠르게 성장한 AI 오픈소스 프로젝트 중 하나입니다.

수익 모델: LangSmith

LangSmith는 LangChain 애플리케이션의 관측성(Observability) 플랫폼입니다.

| 기능 | 설명 |

|---|---|

| Tracing | LLM 호출 체인의 전체 흐름을 시각화 |

| Evaluation | 프롬프트 품질, 응답 정확도를 자동 평가 |

| Monitoring | 지연 시간, 토큰 사용량, 에러율 대시보드 |

| Dataset Management | 테스트용 데이터셋 관리 및 버전 관리 |

| Prompt Hub | 프롬프트 버전 관리 및 팀 공유 |

가격 구조

| 플랜 | 월 비용 | 포함 Trace | 추가 Trace |

|---|---|---|---|

| Developer | 무료 | 5K/월 | — |

| Plus | $39/seat/월 | 10K/seat/월 | $0.50/1K trace |

| Enterprise | 커스텀 | 무제한 협상 | 볼륨 디스카운트 |

핵심 과금 축: Seat(좌석) + Usage(사용량)

이 구조의 의미:

- Seat 과금: 팀이 커지면 비용이 선형 증가 → 예측 가능한 매출

- Usage 과금: 트래픽이 많아지면 추가 비용 → 성장에 연동되는 매출

- 개발자 무료 티어: 프레임워크 사용자가 자연스럽게 LangSmith를 사용해보게 유도

LangSmith의 진짜 킬러 피처는 기능이 아니라 LangChain과의 원클릭 통합입니다.

LANGCHAIN_TRACING_V2=true환경변수 하나면 모든 트레이싱이 켜집니다. 이 통합의 마찰 없음이 전환율의 핵심입니다.

# LangChain → LangSmith 연동: 환경변수 2개면 끝

import os

os.environ["LANGCHAIN_TRACING_V2"] = "true"

os.environ["LANGCHAIN_API_KEY"] = "ls_..."

# 이 시점부터 모든 LangChain 호출이 LangSmith에 자동 기록

from langchain_openai import ChatOpenAI

llm = ChatOpenAI(model="gpt-4o")

llm.invoke("Hello") # → LangSmith에 trace 자동 전송LangChain의 전략적 선택

LangChain은 프레임워크 자체를 점점 모듈화하고 있습니다. langchain-core, langchain-community, langchain-openai 등으로 패키지를 분리하면서, 프레임워크의 유연성은 높이되 LangSmith 없이는 디버깅이 어려운 구조를 만들고 있습니다.

체인이 복잡해질수록, 에이전트가 여러 도구를 호출할수록, 어디서 문제가 생겼는지 추적하기 어려워집니다. 이 복잡성이 LangSmith의 존재 이유입니다.

LlamaIndex → LlamaCloud: 크레딧 기반

프레임워크 포지셔닝

LlamaIndex는 RAG(Retrieval-Augmented Generation) 특화 프레임워크입니다. 문서를 파싱하고, 인덱싱하고, 검색하고, LLM에 전달하는 파이프라인 전체를 커버합니다. LangChain이 범용이라면, LlamaIndex는 “데이터를 LLM에 연결하는 것”에 집중합니다.

수익 모델: LlamaCloud + LlamaParse

LlamaCloud는 RAG 파이프라인의 관리형 인프라입니다.

| 제품 | 역할 | 과금 방식 |

|---|---|---|

| LlamaParse | 문서 파싱 (PDF, DOCX 등) | 크레딧 기반 (페이지당) |

| LlamaCloud Index | 관리형 벡터 인덱스 | 문서 수 + 스토리지 |

| LlamaCloud Pipeline | ETL 파이프라인 자동화 | 실행 횟수 |

가격 구조

| 플랜 | 월 비용 | LlamaParse 크레딧 | 인덱스 |

|---|---|---|---|

| Free | $0 | 1,000 페이지/일 | 1개, 10MB |

| Starter | $35/월 | 10K 페이지/월 | 5개, 500MB |

| Professional | $499/월 | 150K 페이지/월 | 25개, 10GB |

| Enterprise | 커스텀 | 무제한 | 무제한 |

핵심 과금 축: Credits(크레딧)

LlamaIndex의 과금 모델은 LangChain과 다릅니다:

- Seat 과금 없음: 팀 크기가 아니라 처리량에 비례

- 크레딧 = 문서 페이지 수: 사용자의 데이터 볼륨에 직결

- 무료 → 유료 전환 트리거: 1,000페이지/일 초과 시점 = 프로덕션 전환 시점

LlamaParse의 핵심 가치는 “PDF 안의 표, 이미지, 수식을 정확하게 파싱한다”는 것입니다. 오픈소스 파서(pypdf, unstructured)로도 가능하지만, 복잡한 문서에서의 정확도 차이가 유료 전환의 동기가 됩니다.

graph LR

subgraph OSS["오픈소스 (무료)"]

A["LlamaIndex Framework"]

B["pypdf / unstructured"]

end

subgraph CLOUD["LlamaCloud (유료)"]

C["LlamaParse"]

D["Managed Index"]

E["Pipeline"]

end

A -->|"복잡한 문서 파싱 필요"| C

A -->|"인덱스 관리 부담"| D

A -->|"ETL 자동화 필요"| E

style OSS fill:#e3f2fd,stroke:#2196f3

style CLOUD fill:#fff3e0,stroke:#ff9800LlamaIndex의 전략적 선택

LlamaIndex는 “파싱의 어려움”을 수익화했습니다. 간단한 텍스트 문서는 오픈소스로 충분하지만, 금융 보고서, 의학 논문, 법률 문서 등 구조가 복잡한 문서에서는 LlamaParse의 품질 차이가 명확합니다. 이 품질 차이가 크레딧 과금의 정당성을 만듭니다.

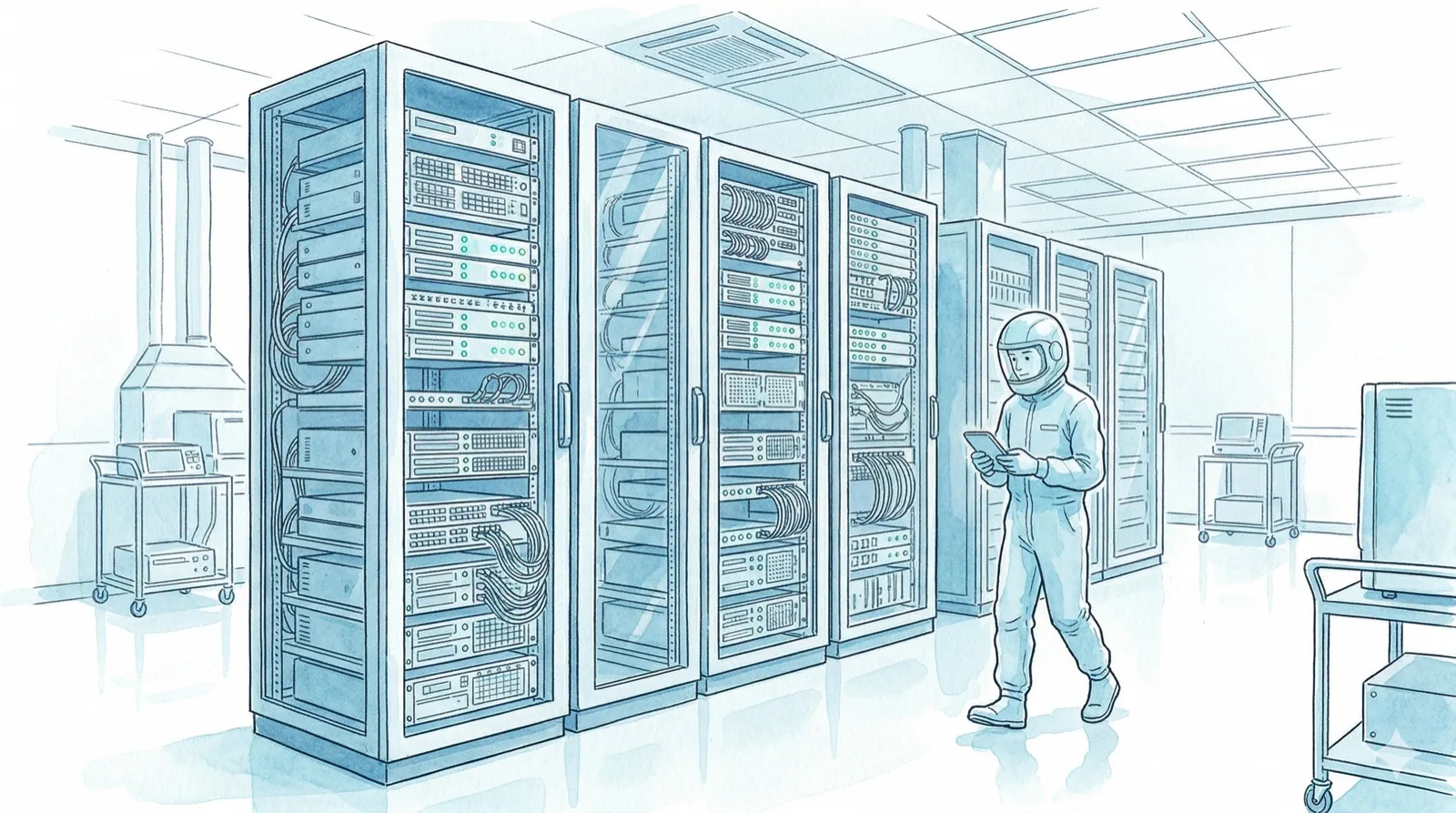

CrewAI → CrewAI Enterprise: 실행량 기반

프레임워크 포지셔닝

CrewAI는 멀티 에이전트 오케스트레이션 프레임워크입니다. 여러 AI 에이전트가 역할을 나누어 협업하는 구조를 쉽게 만들 수 있습니다. LangChain이 단일 체인, LlamaIndex가 RAG이라면, CrewAI는 “에이전트들의 팀워크”에 집중합니다.

수익 모델: CrewAI Enterprise

| 기능 | OSS (무료) | Enterprise (유료) |

|---|---|---|

| 에이전트 정의 | ✅ | ✅ |

| 태스크 오케스트레이션 | ✅ | ✅ |

| 로컬 실행 | ✅ | ✅ |

| 클라우드 배포 | ❌ | ✅ |

| 실행 모니터링 | 기본 로그만 | 대시보드 |

| 에이전트 테스팅 | ❌ | ✅ (자동화) |

| 팀 관리 / RBAC | ❌ | ✅ |

| SLA / 지원 | 커뮤니티 | 전담 |

가격 구조

CrewAI Enterprise는 실행량(Crew Runs) 기반 과금입니다.

| 플랜 | 월 비용 | Crew Runs | 에이전트 수 |

|---|---|---|---|

| Free | $0 | 100 runs/월 | 2 crews |

| Pro | $200/월 | 5,000 runs/월 | 무제한 |

| Enterprise | 커스텀 | 무제한 협상 | 무제한 |

핵심 과금 축: Execution(실행량)

CrewAI의 과금 모델은 가장 직관적입니다:

- 1 Crew Run = 에이전트 팀이 1번 작업을 수행 → 비즈니스 가치와 직결

- 에이전트가 많을수록, 태스크가 복잡할수록 run당 비용 증가 → 사용자의 ROI에 연동

- 무료 100 runs: PoC는 무료로, 프로덕션 전환 시 유료

CrewAI의 장점은 “프레임워크가 곧 제품 경험의 연장선”이라는 점입니다. 코드에서

crew.kickoff()를 호출하는 것과 Enterprise에서 배포 버튼을 누르는 것이 동일한 경험입니다. 개발→운영의 마찰이 최소화됩니다.

3사 비교: 과금 축이 다르다

graph TB

subgraph LANGCHAIN["LangChain"]

LC1["과금 축: Seat + Usage"]

LC2["타깃: 팀 규모 + 트래픽"]

LC3["전환 트리거: 디버깅 필요"]

end

subgraph LLAMAINDEX["LlamaIndex"]

LI1["과금 축: Credits"]

LI2["타깃: 데이터 볼륨"]

LI3["전환 트리거: 복잡한 문서"]

end

subgraph CREWAI["CrewAI"]

CA1["과금 축: Execution"]

CA2["타깃: 자동화 빈도"]

CA3["전환 트리거: 프로덕션 배포"]

end| 비교 항목 | LangChain (LangSmith) | LlamaIndex (LlamaCloud) | CrewAI (Enterprise) |

|---|---|---|---|

| 과금 축 | Seat + Usage | Credits (페이지) | Execution (runs) |

| 무료 티어 | 5K traces/월 | 1K pages/일 | 100 runs/월 |

| 유료 진입가 | $39/seat/월 | $35/월 | $200/월 |

| 엔터프라이즈 | 커스텀 | $499+/월 | 커스텀 |

| 과금 대상 | 팀 크기 × 트래픽 | 데이터 볼륨 | 자동화 빈도 |

| 전환 트리거 | 디버깅이 복잡해질 때 | 문서 파싱 품질 필요 시 | 클라우드 배포 필요 시 |

| Lock-in 강도 | 중간 (트레이싱 데이터) | 높음 (인덱스 + 파이프라인) | 높음 (배포 환경) |

과금 축 선택의 논리

각 회사가 다른 과금 축을 선택한 이유는 프레임워크가 해결하는 문제의 성격이 다르기 때문입니다:

- LangChain: 범용 프레임워크 → 팀이 커질수록 디버깅 복잡도 증가 → seat 과금이 자연스러움

- LlamaIndex: 데이터 중심 → 처리하는 데이터가 많아질수록 비용 증가 → 크레딧 과금이 자연스러움

- CrewAI: 작업 자동화 → 자동화 횟수가 비즈니스 가치 → 실행량 과금이 자연스러움

과금 축은 “사용자가 가장 직관적으로 가치를 느끼는 단위”여야 합니다. 데이터를 많이 처리하는 사용자에게 seat 과금은 부자연스럽고, 팀이 큰 사용자에게 실행량 과금은 예측하기 어렵습니다.

프레임워크 자체로는 왜 돈이 안 되나

1. 한계 비용이 0

소프트웨어 프레임워크는 복제 비용이 0입니다. 한 명이 쓰든 백만 명이 쓰든 개발 비용은 동일합니다. 여기에 라이선스 비용을 붙이면 오픈소스의 채택 이점(경쟁 프레임워크 대비 선택 이유)이 사라집니다.

2. Fork 가능성

MIT 라이선스는 누구나 fork할 수 있습니다. 프레임워크에 과금하면 커뮤니티가 무료 fork를 만듭니다. 실제로 LangChain의 복잡성에 불만을 느낀 개발자들이 여러 경량 대안(LiteLLM, Instructor 등)을 만들었습니다.

3. 개발자 저항

개발자 도구에 과금하면 채택률이 급감합니다. “npm install langchain” 다음에 “신용카드를 등록하세요”가 나오면, 개발자는 다른 프레임워크를 찾습니다.

graph LR

A["프레임워크 무료"] -->|"진입 장벽 0"| B["대규모 채택"]

B -->|"일부가 프로덕션 전환"| C["운영 문제 발생"]

C -->|"운영 도구 필요"| D["유료 플랫폼 전환"]

E["프레임워크 유료"] -->|"진입 장벽 ↑"| F["제한적 채택"]

F -->|"Fork 등장"| G["커뮤니티 이탈"]

style A fill:#e8f5e9,stroke:#4caf50

style D fill:#fff3e0,stroke:#ff9800

style E fill:#ffebee,stroke:#f44336

style G fill:#ffebee,stroke:#f443364. 운영 계층의 전환 비용

반면, 운영 계층(관측성, 인덱스, 배포 환경)은 데이터가 쌓일수록 전환 비용이 높아집니다. 6개월간의 트레이싱 데이터, 수만 건의 인덱스, 배포된 에이전트 파이프라인 — 이것들을 다른 플랫폼으로 옮기는 비용은 프레임워크를 바꾸는 것보다 훨씬 큽니다.

1인 빌더가 참고할 수 있는 패턴

MMU(Make Me Unicorn)를 만들면서 이 세 회사의 모델을 분석한 이유는, 1인 오픈소스 프로젝트에도 적용 가능한 패턴이 있는지 확인하기 위해서였습니다.

적용 가능한 패턴

| 패턴 | 대기업 적용 | 1인 빌더 적용 |

|---|---|---|

| 프레임워크 무료 → 운영 유료 | ✅ LangSmith | ✅ CLI 무료 → Pro 기능 유료 |

| 무료 티어로 유입 | ✅ 5K traces 무료 | ✅ 전체 체크리스트 무료 |

| 환경변수 한 줄로 연동 | ✅ LANGCHAIN_TRACING | ✅ mmu --pro 플래그 |

| 데이터 Lock-in | ✅ 트레이싱 히스토리 | ❌ 1인은 Lock-in 전략 부적합 |

| Seat 과금 | ✅ 팀 규모 스케일 | ❌ 1인 타깃은 솔로 빌더 |

| 엔터프라이즈 세일즈 | ✅ 전담 팀 | ❌ 1인은 불가능 |

적용 불가능한 이유

세 회사의 모델에서 1인 빌더가 직접 복제할 수 없는 부분:

- 엔터프라이즈 세일즈: 3사 모두 매출의 상당 부분이 Enterprise 플랜. 1인이 POC, 보안 심사, SLA 협상을 동시에 진행하는 것은 불가능

- Seat 기반 스케일링: 팀이 커질수록 매출이 증가하는 모델인데, 1인 빌더의 타깃 사용자는 대부분 개인 또는 소규모 팀

- 인프라 운영: LlamaCloud나 CrewAI Enterprise처럼 관리형 인프라를 운영하려면 DevOps 인력과 인프라 비용이 필요

MMU에 적용한 것

MMU는 세 회사의 패턴 중 프레임워크(CLI) 무료 → 부가 콘텐츠(Playbook Pack) 유료 구조만 차용했습니다.

| 단계 | 내용 | 가격 |

|---|---|---|

| What | CLI 체크리스트 534항목 | 무료 (MIT) |

| How | Playbook Pack (항목별 실행 가이드) | $29–49 |

| Auto | AI Coach (자동 진단 + 권고) | $9–19/월 |

프레임워크 회사들의 “무료→유료 전환 축”에서 가장 1인에게 적합한 것은 콘텐츠 축이었습니다. 인프라를 운영할 필요 없고, 좌석 수에 의존하지 않고, 한 번 만들면 한계 비용이 0입니다.

정리

AI 프레임워크 3사의 사업화 모델은 결국 같은 원칙을 따릅니다:

- 프레임워크 자체는 무료 — 개발자 채택을 위한 채널

- 과금은 운영 계층 — 디버깅, 파싱, 배포 등 프로덕션에서 발생하는 문제

- 과금 축은 프레임워크의 핵심 가치와 일치 — LangChain은 팀+트래픽, LlamaIndex는 데이터, CrewAI는 실행

차이점은 과금 축의 선택입니다. 이 선택이 타깃 고객, 무료→유료 전환 시점, lock-in 강도를 결정합니다.

다음 글에서는 관측성(Observability) 플랫폼인 Langfuse와 Dify의 오픈소스 전략을 분석합니다. 프레임워크보다 한 단계 위의 레이어에서 어떤 수익 모델이 가능한지 살펴봅니다.

관련 글

1인 빌더의 오픈소스 사업화 — 엔터프라이즈 없이 가능한가

8개 글로벌 기업 사례를 통해 도출한 1인 빌더용 오픈소스 수익화 프레임워크. 엔터프라이즈 세일즈나 관리형 인프라 없이 'What(무료)-How(유료)' 구조로 수익을 창출하는 5단계 실행 전략과 1인 빌더가 피해야 할 안티패턴 정리.

AI 인프라의 사업화 — Hugging Face, Qdrant, Weaviate

Hugging Face, Qdrant, Weaviate 등 AI 인프라 기업들의 오픈소스 수익화 전략 분석. '소프트웨어는 무료(셀프호스트), 운영은 유료(관리형 클라우드)'라는 레드햇 모델을 AI 스택에 적용하여, GPU 컴퓨팅 시간이나 데이터 스토리지 규모에 따라 수익을 창출하는 구조적 원리 정리.

AI 관측 플랫폼의 사업화 — Langfuse와 Dify의 오픈소스 전략

Langfuse와 Dify의 오픈소스 사업화 전략 분석. MIT+EE 라이선스 모델과 메시지 크레딧 과금 방식을 비교하고, AI 프레임워크보다 관측/운영 레이어가 높은 전환 비용과 지속적 사용성 덕분에 수익화에 유리한 구조적 이유 정리.